Искусственный интеллект научился описывать человеческим языком то, что он видит

Экология потребления. Сначала компьютеры научились распознавать наши лица на фотографиях, а теперь они и вовсе способны

Сначала компьютеры научились распознавать наши лица на фотографиях, а теперь они и вовсе способны достаточно точно описать то, что делает человек на том или ином изображении.

В прошлом месяце инженеры Google продемонстрировали общественности нейронную сеть Deep Dream, которая умеет превращать изображения в фантастические абстрактные видения, теперь же учёные из Стэнфорда представили свою разработку NeuralTalk, способную описывать человеческим языком то, что она видит.

Впервые NeuralTalk была упомянута ещё в прошлом году. Разработкой этой системы руководят директор Лаборатории искусственного интеллекта при Стэнфордском университете Фей-Фей Ли, а также его выпускник Андрей Карпатый. Программное обеспечение, написанное в рамках проекта, способно проанализировать комплексное изображение и точно определить, что на нём происходит, описав всё увиденное разговорным человеческим языком.

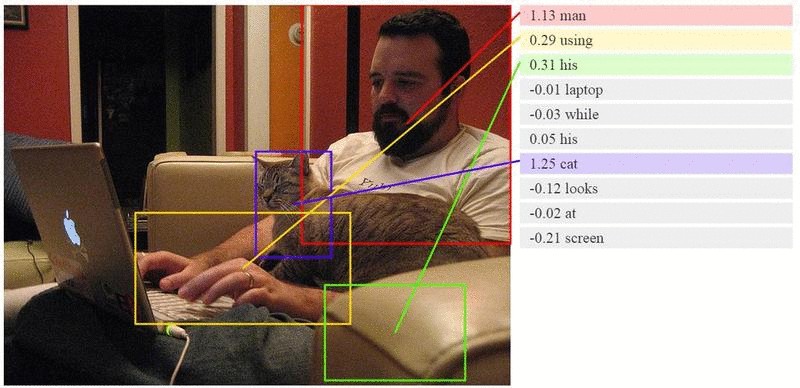

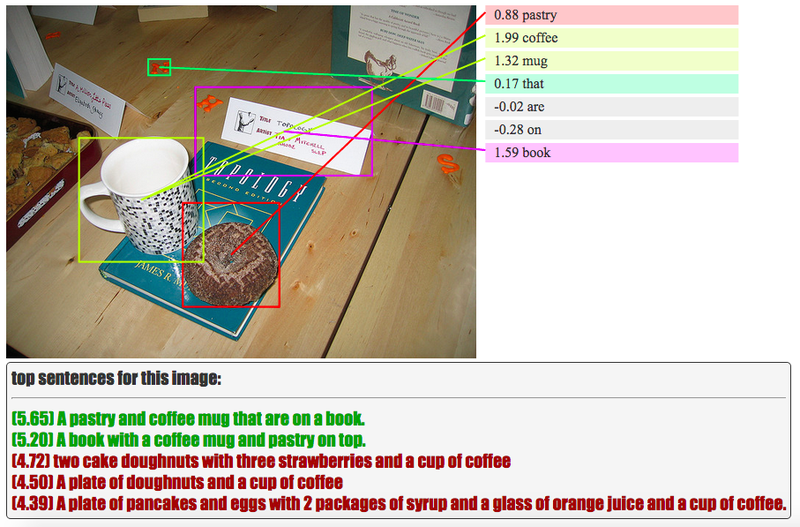

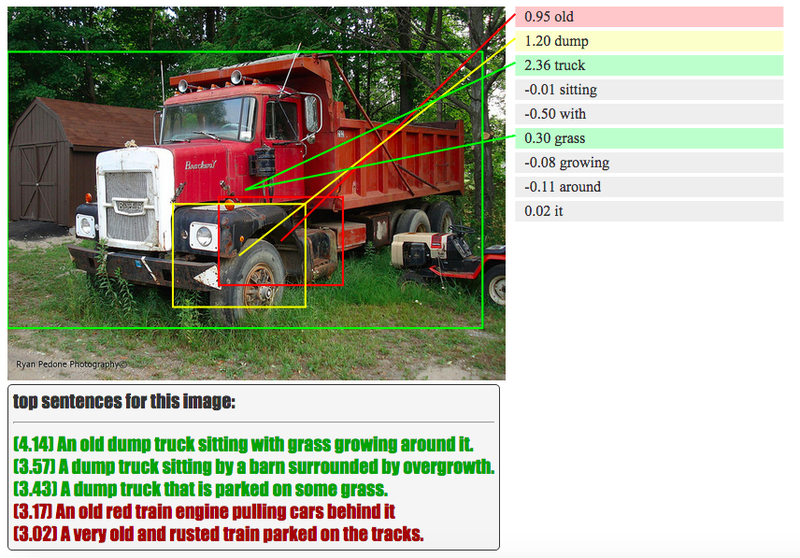

К примеру, если на фото изображён мужчина в чёрной футболке, играющий на гитаре, то искусственный интеллект так и опишет увиденное: «мужчина в чёрной футболке играет на гитаре». Разумеется, работа всё ещё продолжается, так что алгоритм довольно часто допускает забавные ошибки, но без этого в современной науке никуда. Вы можете увидеть чуть ниже, как выглядит интерфейс тестовой версии алгоритма. ИИ отыскивает на изображении отдельные объекты, события или действия и назначает им отдельные слова, в итоге складывая их в осмысленное предложение.

При этом различными цветами отмечаются объекты, в правильности распознавания которых искусственный интеллект уверен в той или иной мере. Вы можете самостоятельно увидеть процесс обучения искусственного интеллекта на официальном сайте исследователей.

Подобно системе Deep Dream от Google, NeuralTalk использует для своей работы нейронную сеть. Алгоритм сравнивает новое изображение с уже виденными ранее фотографиями, подобно маленькому ребёнку осваивая новые слова и запоминая образы объектов. Учёные раз за разом объясняют искусственному интеллекту, как выглядит кошка, гамбургер или ботинок, а NeuralTalk запоминает всё это и практически безошибочно опознаёт эти образы в дальнейшем.

Разработчикам предстоит непростая и очень утомительная работа по обучению голодного до знаний искусственного интеллекта. Они должны развесить миллионы «бирок с названиями» на различные объекты, изображённые на тысячах снимков, прежде чем ИИ научится самостоятельно описывать демонстрируемые ему образы и ситуации. Для начала учёные надеются, что у них получится создать поисковую машину, которая за мгновение сможет найти интересующее вас изображение на бескрайних просторах Интернета.

Потенциально в будущем подобная нейронная сеть способна на гораздо большее. К примеру, этот алгоритм вполне может найти не только фотографию, но и интересующий вас момент в фильме, телесериале или ролике с YouTube.опубликовано econet.ru

P.S. И помните, всего лишь изменяя свое потребление - мы вместе изменяем мир! © econet

Источник: https://econet.ru./

Понравилась статья? Напишите свое мнение в комментариях.

Добавить комментарий